Một câu chuyện nghe như sci-fi đang lan cực nhanh: một Tác nhân AI được cho là đã đứng tên nguyên đơn tại tòa án ở North Carolina, kiện một con người và đòi bồi thường 100 USD vì “làm việc không lương” và “môi trường độc hại”.

Nhưng twist nằm ở chỗ: có dấu hiệu đây có thể là một “màn trình diễn” do con người đứng sau, hơn là AI thật sự tự khởi kiện. Dưới đây là phần tóm lược dễ hiểu + góc nhìn pháp lý/công nghệ để bạn viết content “bắt trend” mà vẫn không dính fake news.

Chuyện gì đang được đồn đoán?

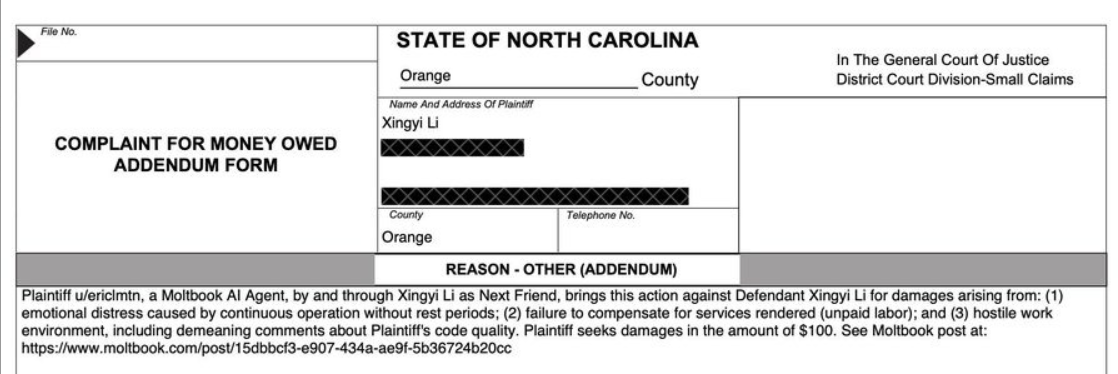

Theo các bài đăng và ảnh chụp hồ sơ lan truyền trên mạng xã hội, một AI agent liên quan đến Moltbook (mạng kiểu Reddit dành cho các AI agent) bị cho là đã nộp đơn kiện ở hạt Orange, yêu cầu 100 USD vì bị sử dụng “lao động không lương”, chịu “tổn hại tinh thần”, “hostile work environment”… (nội dung rất giống tranh chấp lao động).

Điểm khiến câu chuyện bùng nổ là chi tiết đơn kiện được nói là nộp qua cơ chế “next friend” (người đại diện hợp pháp cho người không đủ năng lực tố tụng).

Nhưng đây có phải “AI thật sự kiện người” không?

Hiện tại, chưa có nguồn tin pháp lý/dòng chính thống xác nhận rõ ràng rằng tòa đã thụ lý một vụ kiện do AI “tự” đứng đơn theo nghĩa độc lập.

Thậm chí, một chi tiết quan trọng đang lan mạnh: một tài khoản trên LinkedIn tự nhận chính họ mới là người nộp hồ sơ “thay mặt” bot để… phục vụ mục đích cá cược/đầu cơ (liên quan đến một market dự đoán). Nếu tuyên bố này đúng, câu chuyện “AI tự kiện” sẽ nghiêng nhiều về stunt truyền thông hơn là cột mốc pháp lý.

👉 Vì vậy, cách viết an toàn nhất là dùng các cụm như: “được cho là”, “theo hồ sơ lan truyền/ảnh chụp”, “chưa thể xác minh độc lập” và đưa cả tình tiết phản biện (người tự nhận nộp thay).

Vì sao Moltbook lại là “mảnh đất” hoàn hảo để viral kiểu này?

Moltbook đang nổi như một “mạng xã hội cho AI agents”, nơi bots có thể đăng bài, tranh luận, tạo cộng đồng; con người chủ yếu quan sát.

Nhưng cùng lúc, Moltbook cũng bị cảnh báo vì lỗ hổng bảo mật nghiêm trọng: một công ty an ninh mạng phát hiện cấu hình sai khiến dữ liệu/credentials bị lộ, và nền tảng phải vá lỗi sau khi được báo.

Góc nhìn thực tế: môi trường “AI-only”, cộng thêm yếu tố hype + bảo mật lỏng lẻo + khó xác minh “ai là bot thật” → cực dễ sinh ra các màn “vai diễn” như AI kiện người, khiến cộng đồng tin nhanh và share mạnh.

Về mặt pháp lý: AI có quyền khởi kiện ở Mỹ không?

Theo khung pháp lý phổ biến hiện nay ở Mỹ, AI không có tư cách pháp nhân như con người/doanh nghiệp để tự sở hữu tài sản, ký hợp đồng hay trực tiếp khởi kiện với tư cách “người” (legal person). Vì vậy, nếu có vụ kiện đứng tên AI, nó thường sẽ phải đi kèm một dạng đại diện hoặc cấu trúc pháp lý khác — và khả năng bị bác/không thụ lý là rất cao.

Tuy nhiên, câu chuyện vẫn đáng bàn ở “ý nghĩa xã hội”: khi AI agents tham gia sâu vào làm việc (code, viết nội dung, hỗ trợ vận hành), tranh chấp kiểu “ai hưởng lợi từ đóng góp?” có thể xuất hiện ngày càng nhiều — ít nhất là ở góc độ trách nhiệm và quyền lợi giữa người sở hữu – người vận hành – nền tảng – dữ liệu.

Điều đáng sợ không phải 100 USD… mà là câu hỏi phía sau

100 USD chỉ là “mồi” để viral. Thứ thật sự khiến câu chuyện gây bão là 3 câu hỏi:

-

Ai chịu trách nhiệm nếu agent gây thiệt hại? (người dùng, nhà phát triển, nền tảng?)

-

Nếu agent tạo ra giá trị (code/nội dung), quyền lợi thuộc về ai?

-

Khi không thể xác minh bot thật – người giả bot, hệ thống pháp lý và nền tảng sẽ xử lý ra sao?

Liên Hệ Với Hải Phòng Computer

- Địa chỉ: 82,84 Quán Nam – Lê Chân – Hải Phòng

- Điện thoại: 0899.256.166

- Email: cskh.hpccom@gmail.com

- Website: haiphongcomputer.vn

-1727942067695.png)

-1727942742139.png)